Cisco lanza una herramienta gratuita para verificar el origen de los modelos de IA

Cisco ha publicado Model Provenance Kit, una herramienta de código abierto que permite a las empresas verificar el origen y la integridad de los modelos de IA antes de usarlos. La necesidad es real: según SecurityWeek, las organizaciones que descargan modelos de repositorios como Hugging Face —donde hay más de dos millones disponibles— carecen de cualquier proceso auditable para comprobar si han sido modificados. Y el riesgo no es teórico: investigación de Anthropic confirma que tan solo 250 documentos maliciosos bastan para introducir una puerta trasera en un modelo de lenguaje, independientemente de su tamaño.

El problema de la cadena de suministro

Cuando una empresa descarga un modelo de un repositorio público, ese modelo puede haber pasado por decenas de manos: alguien lo ajusta, otro lo fusiona con otro modelo, un tercero lo vuelve a publicar. En ese proceso, los metadatos originales pueden alterarse o desaparecer. Sin visibilidad sobre ese historial, cualquier fallo o comportamiento inesperado del modelo se convierte en un problema imposible de auditar.

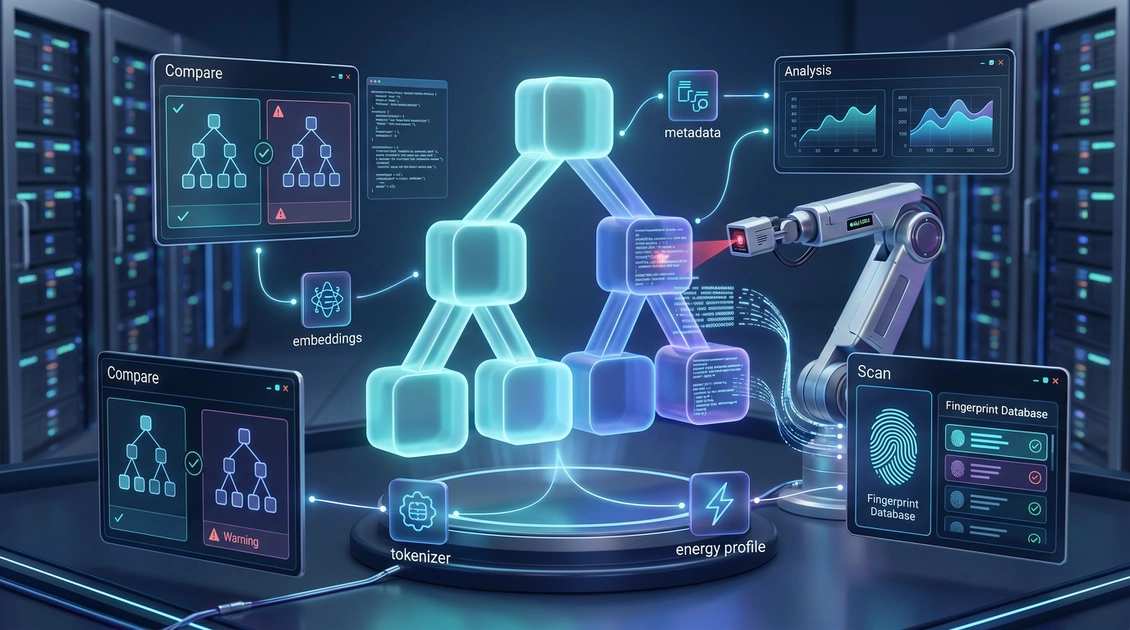

Model Provenance Kit aborda esto generando una "huella digital" de cada modelo. En lugar de fiarse de la documentación, analiza señales técnicas: arquitectura y metadatos, similitud entre tokenizadores, geometría de los embeddings, características de las capas de normalización y perfiles de energía. Con esa huella, el sistema puede detectar si un modelo es derivado de otro aunque se haya intentado ocultar esa relación.

Dos modos de análisis

La herramienta, implementada en Python con interfaz de línea de comandos, funciona de dos maneras. El modo compare confronta directamente dos modelos para determinar si uno desciende del otro o si ha sufrido modificaciones no autorizadas. El modo scan va más lejos: busca coincidencias en una base de datos de huellas digitales que Cisco ya ha construido con cerca de 150 modelos base pertenecientes a 45 familias distintas, con parámetros que van desde 135 millones hasta 70.000 millones.

En pruebas de laboratorio sobre 111 pares de modelos —incluyendo escenarios de destilación, cuantización y ajuste fino entre organizaciones—, el kit alcanzó una precisión del 96,4 % y una precisión de clasificación del 98,1 %, según Help Net Security.

¿Y en España?

Empresas españolas de sectores regulados como banca, sanidad o telecomunicaciones —desde BBVA hasta Telefónica— integran cada vez más modelos abiertos en sus sistemas, pero sin herramientas estandarizadas para auditar su linaje. La AEPD todavía no menciona soluciones de provenance en sus guías sobre IA, y el Reglamento Europeo de IA (AI Act) impone obligaciones de transparencia para sistemas de alto riesgo que serán plenamente exigibles a partir del 2 de agosto de 2026.

Model Provenance Kit está disponible ahora mismo en GitHub Cisco AI Defense de forma gratuita. Para empresas que usan modelos de terceros sin un proceso de verificación, es un punto de partida concreto antes de que la regulación europea lo exija formalmente.